Nel 2017, un'azienda di tè freddo con sede a New York ha dichiarato di voler "passare alla blockchain", e le sue azioni sono balzate di 200%.

Ne parlo perché, sei anni dopo, AI è come ronzio oggi come lo era allora la blockchain. I dipartimenti di marketing hanno cooptato il termine al punto che il significato di "AI" e, cosa più importante, il modo in cui può realmente creare una maggiore sicurezza informatica, possono perdersi nel rumore.

Questo è stato chiaro anche per me alla KuppingerCole Conferenza europea sull'identità e il cloud 2023, dove ho presentato il potenziale dell'IA per prevenire l'acquisizione di account. L'IA non è solo un fenomeno di clamore, ma il suo valore reale nella creazione di una cybersecurity più forte e nell'avvicinamento delle organizzazioni a una fiducia zero può essere offuscato da tutto il clamore.

Definiamo quindi i termini e addentriamoci nelle questioni. Esaminiamo alcuni dei modi in cui la cybersecurity può realmente utilizzare l'IA per elaborare i dati di autenticazione, autorizzazione e utilizzo. E definiamo il tipo di IA che può funzionare al meglio per migliorare la posizione di cybersecurity di un'organizzazione.

La cybersecurity tende a essere suddivisa in competenze fondamentali: l'autenticazione a più fattori (MFA) per proteggere l'accesso, la governance e l'amministrazione dell'identità (IGA) per imporre il minimo privilegio, la gestione degli incidenti e degli eventi di sicurezza (SIEM) per monitorare l'utilizzo, ecc.

Ciascuna di queste competenze è altamente specializzata, impiega strumenti propri e si protegge da rischi diversi. Ciò che hanno in comune è che tutte producono montagne di dati.

Guardate l'identità, che sta aggiungendo più utenti, dispositivi, diritti e ambienti che mai. In un 2021 Oltre 80% degli intervistati hanno dichiarato che il numero di identità gestite è più che raddoppiato e 25% hanno segnalato un aumento di 10 volte.

L'identità sta rapidamente diventando un problema di dati: ci sono più informazioni di quante l'uomo ne possa gestire. Ecco perché l'IA può essere una risorsa così importante: l'IA può dare un senso a grandi quantità di dati in modo rapido se si inquadra correttamente la domanda e si sa cosa chiedere all'IA.

Ecco le tre domande che i professionisti della cybersecurity possono utilizzare per prevenire i rischi e rilevare le minacce:

#1. Autenticazione: utilizzare l'IA per capire chi sta cercando di entrare

L'intelligenza artificiale è in grado di elaborare i dati di autenticazione per valutare chi sta cercando di accedere al vostro sistema. Lo fa esaminando il contesto di ogni utente, compreso il dispositivo che sta utilizzando, l'ora in cui sta cercando di accedere, il luogo da cui sta accedendo e altro ancora.

Il passo successivo consiste nell'utilizzare le informazioni attuali e confrontarle con il comportamento passato di quel particolare utente: se questa settimana mi autentico dallo stesso portatile, alle stesse ore e dallo stesso indirizzo IP della settimana scorsa, il mio contesto sarà probabilmente abbastanza buono.

In alternativa, se qualcuno che sostiene di essere me cerca di accedere da un nuovo dispositivo alle 3 del mattino e da un nuovo indirizzo IP, l'intelligenza artificiale dovrebbe automatizzare l'autenticazione graduale per contrastare questo comportamento sospetto.

È importante sottolineare che le decisioni su ciò che costituisce un "buon contesto" e un "cattivo contesto" non sono statiche: l'IA deve invece rivalutare costantemente le sue decisioni per riflettere il comportamento generale degli utenti e delle organizzazioni e adattarsi a ciò che sembra "normale". Il comportamento degli utenti cambia sempre e l'IA deve sempre tenerne conto.

I set di regole statiche non sono abbastanza precisi da tenere conto del contesto individuale e non hanno la profondità dei dati di riferimento necessaria per automatizzare le azioni con sicurezza.

O, per dirla in un altro modo: gli insiemi di regole statiche non saranno in grado di sapere se è normale che io, nello specifico io, cerchi di registrarmi per l'8th entro 60 minuti dalle 23:00 tedesche. Forse è un comportamento normale per me, o forse è sospetto. In ogni caso, le regole statiche non sono in grado di dirlo.

Per quasi 20 anni, RSA ha utilizzato algoritmi di apprendimento automatico e analisi comportamentale per aiutare i clienti a definire i contesti "buoni" e "cattivi" e ad automatizzare le risposte ai comportamenti degli utenti. RSA Risk AI elabora la grande quantità di dati generati dagli utenti per integrare le tecniche di autenticazione e accesso tradizionali e aiutare le aziende a prendere decisioni di accesso più intelligenti, rapide e sicure su scala.

#2 Account e diritti: utilizzare l'IA per capire a cosa si può accedere.

L'intelligenza artificiale elabora i dati di autenticazione per scoprire che sta cercando di accedere. Esamina i dati relativi all'account e alle autorizzazioni per rispondere a una domanda diversa: cosa potrebbe Qualcuno può accedervi?

I bot rispondono a questa esigenza esaminando gli account e le autorizzazioni per le varie applicazioni. Questo aiuta le organizzazioni a passare al privilegio minimo (un importante elemento costitutivo della fiducia zero). Ciò può anche aiutare le organizzazioni a identificare eventuali violazioni della segregazione dei compiti.

Per gli esseri umani, elaborare le informazioni sui conti e sui diritti sarebbe quasi impossibile: i record dei diritti possono raggiungere rapidamente i milioni. L'esame manuale di questi dati è destinato a fallire: un revisore umano potrebbe premere "Approva tutto" e chiudere la questione.

Tuttavia, se da un lato l'analisi approfondita dei diritti è molto impegnativa, dall'altro è anche molto utile, soprattutto per sviluppare una posizione più forte in materia di cybersicurezza. Poiché gli esseri umani sono così rapidi nel premere il pulsante "Approva tutto", creiamo account che hanno molti più diritti di quanti ne abbiano bisogno: solo 2% di diritti sono utilizzati.

Questi rischi di abilitazione aumentano con l'integrazione di più ambienti cloud da parte delle organizzazioni: Gartner prevede che la "gestione inadeguata di identità, accesso e privilegi causerà 75% di fallimenti nella sicurezza del cloud" quest'anno e che la metà delle aziende esporrà erroneamente alcune delle proprie risorse direttamente al pubblico.

Le organizzazioni possono trovare informazioni preziose, come gli utenti anomali, cercando tra i dati relativi ai diritti. Gli utenti anomali sono molto simili ad altri gruppi di utenti, ma presentano alcune combinazioni di diritti che li rendono diversi. Queste differenze possono non essere così evidenti come una violazione della segregazione dei compiti, ma possono comunque essere abbastanza significative da essere riconosciute dall'intelligenza artificiale. Una verifica degli accessi si concentrerebbe su questi utenti anomali e non sugli altri 99% di utenti i cui diritti sono considerati a basso rischio o che hanno avuto gli stessi diritti approvati in precedenza.

Trovare quei piccoli aghi in tutti quei pagliai torreggianti è facile per l'intelligenza artificiale e quasi impossibile per gli esseri umani.

#3. Utilizzo dell'applicazione: Utilizzare l'intelligenza artificiale per capire cosa sta facendo realmente una persona

L'intelligenza artificiale analizza i dati di autenticazione per determinare che sta cercando di ottenere l'accesso. Esamina i dati relativi ai diritti per capire che cosa potrebbe accesso.

Quando si tratta di dati sull'utilizzo delle applicazioni, l'intelligenza artificiale cerca di rispondere a ciò che una persona effettivamente fa.

C'è un flusso costante di dati incredibilmente utili in tempo reale attraverso tutte le applicazioni e i componenti dell'infrastruttura di un'organizzazione: un'intelligenza artificiale potrebbe vedere quali risorse ho realmente utilizzato per scrivere questo post sul blog, a chi mi sono rivolto per chiedere aiuto, i dati che ho consultato, le app che ho usato e così via. In questo modo la mia organizzazione può sapere cosa sto facendo e quali sono i passaggi realmente necessari per portarlo a termine.

È importante notare che l'analisi può anche rivelare attività scorrette, illegali, non conformi o rischiose: solo perché un utente ha legittimamente un diritto non significa che sia dovrebbe. L'intelligenza artificiale può elaborare i dati di utilizzo delle applicazioni per trovare questi errori e risolverli. Certo, avete i diritti per quel sito SharePoint sensibile, ma perché state scaricando una grande quantità di file da quel sito negli ultimi 30 minuti?

Esistono due tipi principali di IA: deterministica e non deterministica. L'apprendimento automatico è principalmente un'IA deterministica. È la migliore per l'elaborazione di dati strutturati. L'apprendimento profondo è spesso un tipo di IA non deterministica, più adatta a elaborare dati non strutturati.

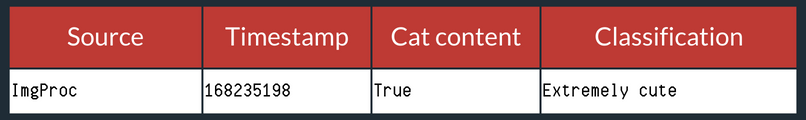

Un altro modo per dirlo: Il Deep Learning sarebbe in grado di guardare questa immagine e rispondere "Dov'è il gatto nella foto?".

Il Machine Learning sarebbe in grado di esaminare un file di log e rispondere a "Cosa è successo al timestamp 168235198?".

Nel campo della sicurezza, sia che si cerchi di utilizzare l'intelligenza artificiale per valutare l'autenticazione, i diritti o i dati di utilizzo delle applicazioni, le informazioni che stiamo esaminando sono quasi esclusivamente dati strutturati.

Ciò significa che, in linea di massima, vogliamo utilizzare l'apprendimento automatico, o l'IA deterministica, nella cybersecurity. L'IA deterministica può gestire gli input che le forniamo in modo più trasparente rispetto all'IA non deterministica. "In modo più trasparente" perché, diciamocelo, non tutti (me compreso) abbiamo le conoscenze matematiche avanzate per conoscere tutti i dettagli. Tuttavia, molte persone lo fanno e un modello di ML deterministico può essere spiegato loro nella sua interezza.

C'è ricerca per comprendere meglio il funzionamento delle IA non deterministiche. Sono curioso di sapere dove porterà tutto questo e se finiremo per capire completamente come funzionano le reti neurali e altre IA non deterministiche.

Altrettanto importante della gestione di questi input strutturati sono gli output che l'IA deterministica produce. L'IA non deterministica è più una scatola nera: noi umani non possiamo essere sicuri di come un'IA non deterministica abbia prodotto una determinata immagine, ad esempio. C'è l'input all'inizio, l'output alla fine, e se si aprisse la scatola nera nel mezzo si vedrebbe una terra fantastica di draghi e unicorni: è semplicemente un mistero.

Con l'IA deterministica, possiamo sapere come il nostro modello è arrivato alla sua risposta. In teoria, potremmo controllare il lavoro di un'intelligenza artificiale deterministica e inserire manualmente gli stessi input per ottenere la stessa risposta. Ma farlo manualmente richiederebbe una quantità spropositata di carta da lettere, caffè e sanità mentale e non può essere fatto in tempo reale.

Per i team di sicurezza e di audit, la trasparenza e la comprensione del funzionamento dell'IA sono fondamentali per mantenere la conformità e richiedere le certificazioni.

Questo non vuol dire che non ci sia un ruolo per gli algoritmi non deterministici o di deep learning nella cybersecurity. Ci sono: il deep learning può trovare risposte che non abbiamo cercato e può essere usato per migliorare i modelli deterministici. I professionisti della cybersicurezza dovrebbero riporre una quantità significativa di fiducia in questa scatola nera e in ciò che produce.

Scommettiamo molto sull'IA e pensiamo che possa avere un ruolo significativo nella creazione di una cybersecurity più forte.

Ma altrettanto importante dell'intelligenza artificiale è che tutti i componenti dell'identità lavorino insieme: autenticazione, accesso, governance e ciclo di vita devono collaborare per proteggere l'intero ciclo di vita dell'identità.

Combinando queste funzioni in un piattaforma di identità unificata aiuta le organizzazioni a proteggere i punti ciechi che derivano dalle soluzioni puntuali; inoltre, crea più dati in ingresso per addestrare l'IA a diventare ancora più intelligente.