Ya en 2017, una empresa de té helado con sede en Nueva York dijo que estaba "pivotando hacia la blockchain", y sus acciones se dispararon un 200%.

Traigo esto a colación porque, seis años después, AI es como zumbido hoy como lo era entonces la cadena de bloques. Los departamentos de marketing han cooptado el término hasta el punto de que lo que significa "IA" -y lo que es más importante, cómo puede realmente crear una ciberseguridad más sólida- puede perderse en el ruido.

Eso me quedó claro incluso en el KuppingerCole Conferencia Europea sobre Identidad y Nube 2023, en el que presenté el potencial de la IA para evitar la usurpación de cuentas. La IA es mucho más que un simple bombo publicitario, pero su valor real a la hora de reforzar la ciberseguridad y acercar a las organizaciones a la confianza cero puede quedar ahogado por toda la expectación.

Así pues, definamos nuestros términos y entremos en materia. Repasemos algunas de las formas en que la ciberseguridad puede utilizar realmente la IA para procesar datos de autenticación, derechos y uso. Y definamos el tipo de IA que puede funcionar mejor para mejorar la postura de ciberseguridad de una organización.

La ciberseguridad tiende a subdividirse en competencias básicas: autenticación multifactor (MFA) para asegurar el acceso, gobierno y administración de identidades (IGA) para aplicar los mínimos privilegios, gestión de incidentes y eventos de seguridad (SIEM) para supervisar el uso, etc., etc.

Cada una de esas competencias está muy especializada, despliega sus propias herramientas y protege contra riesgos diferentes. Lo que todas tienen en común es que producen montañas de datos.

Fíjese en la identidad, que está añadiendo más usuarios, dispositivos, derechos y entornos que nunca. En un 2021 más de 80% de los encuestados afirmaron que el número de identidades que gestionaban se había más que duplicado, y 25% declararon que se había multiplicado por 10.

La identidad se está convirtiendo rápidamente en un problema de datos: hay más información de la que los humanos pueden manejar. Y por eso la IA puede ser un activo tan importante: la IA puede dar sentido a grandes cantidades de datos rápidamente si planteas la pregunta correctamente y sabes qué debes preguntarle a la IA.

Estas son las tres preguntas que los profesionales de la ciberseguridad pueden utilizar para prevenir riesgos y detectar amenazas:

#1. Autenticación: utilizar la IA para saber quién intenta entrar.

La IA puede procesar datos de autenticación para evaluar quién está intentando autenticarse en su sistema. Para ello, examina el contexto de cada usuario, incluido el dispositivo que utiliza, la hora a la que intenta acceder, la ubicación desde la que accede, etc.

El siguiente paso es utilizar esa información actual y compararla con el comportamiento pasado de ese usuario en particular: si esta semana me autentifico desde el mismo portátil, a las mismas horas y desde la misma dirección IP que la semana pasada, entonces mi contexto probablemente se verá bastante bien.

Por otra parte, si alguien que dice ser yo intenta iniciar sesión desde un nuevo dispositivo a las 3 de la madrugada y desde una nueva dirección IP, la IA debería automatizar la autenticación escalonada para cuestionar ese comportamiento sospechoso.

Y lo que es más importante, esas decisiones sobre lo que constituye un "buen contexto" y un "mal contexto" no son estáticas: en lugar de ello, la IA debe reevaluar constantemente sus decisiones para reflejar el comportamiento general de los usuarios y las organizaciones y adaptarse a lo que parezca "normal". El comportamiento de los usuarios siempre cambia y la IA debe tenerlo en cuenta.

Los conjuntos de reglas estáticas no son lo suficientemente precisos como para tener en cuenta el contexto individual y carecen de la profundidad de los datos de referencia necesarios para automatizar acciones con confianza.

O, dicho de otro modo: los conjuntos de reglas estáticas no podrán saber si es normal que yo -específicamente yo- intente registrarme para el 8th hora en 60 minutos desde Alemania a las 23:00. Tal vez sea un comportamiento normal para mí, o tal vez sea sospechoso. En cualquier caso, las reglas estáticas no podrán saberlo.

Durante casi 20 años, RSA ha estado utilizando algoritmos de aprendizaje automático y análisis de comportamiento para ayudar a los clientes a definir cómo es el contexto "bueno" y "malo" y automatizar las respuestas a los comportamientos de los usuarios. RSA Risk AI procesa la enorme cantidad de datos que generan los usuarios para complementar las técnicas tradicionales de autenticación y acceso y ayudar a las empresas a tomar decisiones de acceso más inteligentes, rápidas y seguras a escala.

#2 Cuenta y derecho: utilizar la IA para saber a qué puede acceder una persona

La IA procesa los datos de autenticación para averiguar que está intentando acceder. Revisa los datos de cuentas y autorizaciones para responder a una pregunta diferente: ¿qué podría ¿alguien tiene acceso?

Los robots responden a esta pregunta examinando las cuentas y los derechos de varias aplicaciones. Esto ayuda a las organizaciones a avanzar hacia el mínimo privilegio (un componente importante de la confianza cero). Esto también puede ayudar a las organizaciones a identificar cualquier violación de la segregación de funciones.

Para los humanos, procesar la información de cuentas y derechos sería casi imposible: los registros de derechos pueden alcanzar rápidamente los millones. Revisar esos datos manualmente está abocado al fracaso: un revisor humano probablemente pulsaría "Aprobar todo" y se daría por vencido.

Pero aunque realizar una revisión exhaustiva de los derechos supone un gran esfuerzo, también tiene un gran valor, sobre todo a la hora de desarrollar una postura de ciberseguridad más sólida. Como los humanos somos tan rápidos a la hora de pulsar el botón "Aprobar todo", estamos creando cuentas que tienen muchos más derechos de los que necesitan: sólo 2% de derechos.

Estos riesgos de asignación de derechos aumentan a medida que las organizaciones integran más entornos de nube: Gartner predice que la "gestión inadecuada de identidades, accesos y privilegios causará 75% de fallos de seguridad en la nube" este año, y que la mitad de las empresas expondrán por error algunos de sus recursos directamente al público.

Las organizaciones pueden encontrar información valiosa, como usuarios atípicos, buscando en sus datos de derechos. Los usuarios atípicos se parecen mucho a otros grupos de usuarios, pero tienen algunas combinaciones de derechos que los hacen diferentes. Estas diferencias pueden no ser tan obvias como una violación de la segregación de funciones, pero aún así pueden ser lo suficientemente significativas como para que la IA las reconozca. Una revisión de acceso se centraría en esos usuarios atípicos, y no en los otros 99% de usuarios cuyos derechos se consideran de menor riesgo o que han tenido los mismos derechos aprobados anteriormente.

Encontrar esas pequeñas agujas en todos esos enormes pajares es fácil para la IA y casi imposible para los humanos.

#3. Uso de la aplicación: Utilizar la IA para saber lo que alguien está haciendo realmente

La IA examina los datos de autenticación para determinar que está intentando acceder. Examina los datos de los derechos para comprender lo que alguien podría acceso.

Cuando se trata de datos de uso de aplicaciones, la IA intenta responder a lo que alguien realmente hace.

Existe un flujo constante de datos en tiempo real increíblemente útiles a través de todas las aplicaciones y componentes de la infraestructura de una organización: una IA podría ver qué recursos he utilizado realmente para escribir esta entrada del blog, a quién he pedido ayuda, los datos que he consultado, las aplicaciones que he utilizado, etcétera. Eso informa a mi organización de lo que estoy haciendo y de los pasos que realmente he necesitado para completarlo.

Y lo que es más importante, ese análisis también puede revelar actividades incorrectas, ilegales, fuera de la normativa o de riesgo: que un usuario tenga legítimamente un derecho no significa que debe. AI puede procesar los datos de uso de las aplicaciones para encontrar esos errores y solucionarlos. Claro, usted tiene los derechos para ese sitio sensible de SharePoint, pero ¿por qué está descargando una gran cantidad de archivos de él durante los últimos 30 minutos?

Existen dos tipos principales de IA: determinista y no determinista. El aprendizaje automático es principalmente IA determinista. Es la mejor para procesar datos estructurados. El aprendizaje profundo suele ser un tipo de IA no determinista que procesa mejor los datos no estructurados.

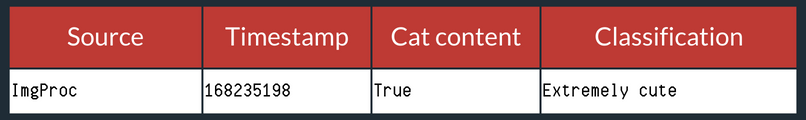

Otra forma de decirlo: Deep Learning sería capaz de mirar esta imagen y responder "¿Dónde está el gato en la foto?".

Machine Learning sería capaz de mirar un archivo de registro y responder "¿Qué pasó en Timestamp 168235198?"

En el ámbito de la seguridad, tanto si se trata de utilizar la IA para evaluar la autenticación, los derechos o los datos de uso de las aplicaciones, la información que analizamos son casi exclusivamente datos estructurados.

Eso significa que, en gran medida, queremos utilizar el aprendizaje automático, o IA determinista, en la ciberseguridad. La IA determinista puede manejar las entradas que le damos de forma más transparente que la IA no determinista. "Más transparente" porque, admitámoslo, no todos (yo incluido) tenemos los conocimientos matemáticos avanzados para conocer todos los detalles. Sin embargo, mucha gente sí, y un modelo de ML determinista se les puede explicar en su totalidad.

Hay investigación para comprender mejor cómo funcionan las IA no deterministas. Tengo curiosidad por saber adónde nos lleva esto y si acabaremos comprendiendo completamente cómo funcionan realmente las redes neuronales y otras IA no deterministas.

Tan importante como manejar esas entradas estructuradas son las salidas que produce la IA determinista. La IA no determinista es más bien una caja negra: los humanos no podemos estar seguros de cómo una IA no determinista produce una imagen determinada, por ejemplo. Está la entrada al principio, la salida al final, y si abriéramos esa caja negra por la mitad veríamos una tierra de fantasía de dragones y unicornios: simplemente es un misterio.

Con la IA determinista, podemos saber cómo ha llegado nuestro modelo a la respuesta. En teoría, podríamos comprobar el trabajo de una IA determinista e introducir manualmente las mismas entradas para llegar a la misma respuesta. Pero hacerlo manualmente requeriría una cantidad ingente de papel, café y cordura, y no podría hacerse en tiempo real.

Para los equipos de seguridad y auditoría, tener esa transparencia y comprender cómo funciona su IA es fundamental para mantener el cumplimiento y solicitar certificaciones.

Esto no quiere decir que los algoritmos no deterministas o de aprendizaje profundo no tengan un papel en la ciberseguridad. Lo hay: el aprendizaje profundo puede encontrar respuestas que no buscamos y puede utilizarse para mejorar los modelos deterministas. Los profesionales de la ciberseguridad tendrían que confiar mucho en esa caja negra y en lo que produce.

Apostamos fuerte por la IA y creemos que puede desempeñar un papel importante en la creación de una ciberseguridad más sólida.

Pero tan importante como la IA es que todos los componentes de la identidad funcionen juntos: la autenticación, el acceso, la gobernanza y el ciclo de vida deben colaborar para proteger todo el ciclo de vida de la identidad.

Combinando estas funciones en un plataforma de identidad unificada ayuda a las organizaciones a proteger los puntos ciegos que resultan de las soluciones puntuales; también crea más entradas de datos para entrenar a la IA en algo aún más inteligente.