Im Jahr 2017 erklärte ein in New York ansässiges Eisteeunternehmen, es wolle "auf die Blockchain umsteigen", und seine Aktien stiegen um 200%.

Ich erwähne das, weil ich sechs Jahre später AI ist als . heute genauso wie damals die Blockchain. Die Marketingabteilungen haben den Begriff so sehr vereinnahmt, dass die Bedeutung von "KI" - und vor allem die Frage, wie sie wirklich zu mehr Cybersicherheit beitragen kann - im Lärm untergehen kann.

Das wurde mir auch bei der KuppingerCole deutlich Europäische Identitäts- und Cloud-Konferenz 2023, wo ich über das Potenzial von KI zur Verhinderung von Kontoübernahmen referierte. KI ist mehr als nur ein Hype, aber ihr tatsächlicher Wert für die Schaffung einer stärkeren Cybersicherheit und die Annäherung von Unternehmen an ein Null-Vertrauen kann von dem ganzen Trubel übertönt werden.

Definieren wir also unsere Begriffe und gehen wir der Sache auf den Grund. Sehen wir uns einige der Möglichkeiten an, wie die Cybersicherheit KI wirklich nutzen kann, um Authentifizierungs-, Berechtigungs- und Nutzungsdaten zu verarbeiten. Und lassen Sie uns die Art von KI definieren, die am besten geeignet ist, die Cybersicherheit eines Unternehmens zu verbessern.

Cybersicherheit wird in der Regel in Kernkompetenzen unterteilt: Multi-Faktor-Authentifizierung (MFA) zur Sicherung des Zugangs, Identitätsmanagement und -verwaltung (IGA) zur Durchsetzung der geringsten Privilegien, Sicherheitsvorfall- und Ereignisverwaltung (SIEM) zur Überwachung der Nutzung usw. usw.

Jeder dieser Bereiche ist hochspezialisiert, setzt seine eigenen Werkzeuge ein und schützt vor unterschiedlichen Risiken. Was sie alle gemeinsam haben, ist, dass sie Berge von Daten produzieren.

Schauen Sie sich die Identität an, die mehr Benutzer, Geräte, Berechtigungen und Umgebungen als je zuvor umfasst. In einer 2021 Umfrage gaben mehr als 80% der Befragten an, dass sich die Zahl der von ihnen verwalteten Identitäten mehr als verdoppelt hat, und 25% berichteten von einem 10-fachen Anstieg.

Identität wird schnell zu einem Datenproblem: Es gibt mehr Informationen, als Menschen verarbeiten können. Und genau deshalb kann KI eine so wichtige Hilfe sein: KI kann große Datenmengen schnell durchschauen, wenn man die Frage richtig formuliert und weiß, was man KI fragen sollte.

Im Folgenden finden Sie drei Fragen, die Cybersecurity-Experten nutzen können, um Risiken zu vermeiden und Bedrohungen zu erkennen:

#1. Authentifizierung: Nutzung von KI, um zu verstehen, wer sich Zugang verschaffen will

KI kann Authentifizierungsdaten verarbeiten, um festzustellen, wer versucht, sich bei Ihrem System zu authentifizieren. Dazu wird der Kontext jedes Benutzers untersucht, einschließlich des Geräts, das er verwendet, der Zeit, zu der er versucht, auf das System zuzugreifen, des Standorts, von dem aus er darauf zugreift, und mehr.

Der nächste Schritt besteht darin, diese aktuellen Informationen mit dem früheren Verhalten des betreffenden Benutzers zu vergleichen: Wenn ich mich in dieser Woche von demselben Laptop, zu denselben Zeiten und von derselben IP-Adresse aus authentifiziere wie in der letzten Woche, dann sieht mein Kontext wahrscheinlich ziemlich gut aus.

Oder wenn jemand, der behauptet, ich zu sein, nachts um 3 Uhr versucht, sich von einem neuen Gerät und einer neuen IP-Adresse aus anzumelden, dann sollte KI eine Step-up-Authentifizierung automatisieren, um dieses verdächtige Verhalten zu hinterfragen.

Wichtig ist, dass diese Entscheidungen darüber, was ein "guter Kontext" und was ein "schlechter Kontext" ist, nicht statisch sind: Die KI sollte ihre Entscheidungen ständig neu bewerten, um das allgemeine Verhalten der Nutzer und Unternehmen zu berücksichtigen und sich an das anzupassen, was "normal" ist. Das Nutzerverhalten ändert sich ständig, und die KI muss dies stets berücksichtigen.

Statische Regelsätze sind nicht fein genug, um den individuellen Kontext zu berücksichtigen, und verfügen nicht über die Tiefe der Referenzdaten, die erforderlich sind, um Aktionen zuverlässig zu automatisieren.

Oder anders ausgedrückt: Statische Regelsätze können nicht wissen, ob es normal ist, dass ich mich für die 8th Zeit innerhalb von 60 Minuten ab Deutschland um 23:00 Uhr. Vielleicht ist das ein normales Verhalten für mich, vielleicht ist es aber auch verdächtig. So oder so, statische Regelwerke werden das nicht erkennen können.

Für fast 20 Jahre, RSA nutzt Algorithmen des maschinellen Lernens und Verhaltensanalysen, um Kunden bei der Definition von "gutem" und "schlechtem" Kontext zu unterstützen und die Reaktionen auf das Verhalten der Benutzer zu automatisieren. RSA Risiko AI verarbeitet die riesigen Datenmengen, die Benutzer generieren, um herkömmliche Authentifizierungs- und Zugangstechniken zu ergänzen und Unternehmen dabei zu helfen, intelligentere, schnellere und sicherere Zugangsentscheidungen in großem Umfang zu treffen.

#2 Konto und Berechtigung: Nutzung von KI, um zu erfahren, worauf jemand zugreifen kann

KI verarbeitet Authentifizierungsdaten, um herauszufinden die versucht, Zugang zu erhalten. Sie prüft Konto- und Berechtigungsdaten, um eine andere Frage zu beantworten: Was könnte jemand Zugang?

Bots beantworten diese Frage, indem sie die Konten und Berechtigungen für verschiedene Anwendungen überprüfen. Auf diese Weise können Unternehmen zu den geringsten Privilegien übergehen (ein wichtiger Baustein von Zero Trust). Auf diese Weise können Unternehmen auch Verstöße gegen die Aufgabentrennung erkennen.

Für Menschen wäre die Verarbeitung von Konto- und Anspruchsdaten nahezu unmöglich: Anspruchsdatensätze können schnell in die Millionen gehen. Die manuelle Überprüfung dieser Daten ist zum Scheitern verurteilt - ein menschlicher Prüfer würde wahrscheinlich auf "Alle genehmigen" klicken und damit fertig sein.

Eine gründliche Überprüfung der Berechtigungen ist zwar sehr aufwändig, aber auch sehr wertvoll - vor allem, wenn es darum geht, eine stärkere Haltung zur Cybersicherheit zu entwickeln. Weil Menschen so schnell auf die Schaltfläche "Alles genehmigen" klicken, erstellen wir Konten, die viel mehr Berechtigungen haben, als sie benötigen: nur 2% von Ansprüchen verwendet werden.

Diese Risiken steigen, wenn Unternehmen mehr Cloud-Umgebungen integrieren: Gartner prognostiziert, dass die unzureichende Verwaltung von Identitäten, Zugriffsrechten und Privilegien in diesem Jahr 75% der Sicherheitsfehler in der Cloud verursachen wird" und dass die Hälfte der Unternehmen irrtümlich einige ihrer Ressourcen direkt der Öffentlichkeit zugänglich machen wird.

Unternehmen können wertvolle Erkenntnisse - wie Ausreißer - gewinnen, indem sie ihre Berechtigungsdaten durchsuchen. Ausreißer-Nutzer sehen anderen Nutzergruppen sehr ähnlich, weisen aber einige Kombinationen von Berechtigungen auf, die sie von anderen unterscheiden. Diese Unterschiede sind vielleicht nicht so offensichtlich wie Verstöße gegen die Aufgabentrennung, können aber dennoch so signifikant sein, dass die KI sie erkennt. Eine Zugriffsüberprüfung würde sich auf diese Ausreißer konzentrieren - und nicht auf die anderen 99% von Nutzern, deren Berechtigungen als weniger risikoreich eingestuft werden oder die dieselben Berechtigungen bereits zuvor genehmigt bekommen haben.

Die kleinen Nadeln in all den riesigen Heuhaufen zu finden, ist für die KI ein Leichtes und für den Menschen nahezu unmöglich.

#3. Anwendung Nutzung: KI nutzen, um zu erfahren, was jemand wirklich tut

KI prüft Authentifizierungsdaten, um festzustellen die versucht, Zugang zu erhalten. Sie prüft die Berechtigungsdaten, um zu verstehen, was jemand könnte Zugang.

Wenn es um Daten zur Anwendungsnutzung geht, versucht KI zu beantworten, was jemand tatsächlich tut.

Es gibt einen ständigen Strom unglaublich nützlicher Echtzeitdaten über alle Anwendungen und Komponenten der Infrastruktur eines Unternehmens: Eine KI könnte sehen, welche Ressourcen ich tatsächlich zum Schreiben dieses Blogbeitrags verwendet habe, wen ich um Hilfe gebeten habe, welche Daten ich konsultiert habe, welche Anwendungen ich verwendet habe und so weiter. Das gibt meinem Unternehmen Aufschluss darüber, was ich tue und welche Schritte ich dafür wirklich gebraucht habe.

Wichtig ist, dass diese Analyse auch inkorrekte, illegale, nicht konforme oder riskante Aktivitäten aufdecken kann: Nur weil ein Nutzer rechtmäßig eine Berechtigung hat, bedeutet das nicht, dass er sollte. AI kann Anwendungsnutzungsdaten verarbeiten, um diese Fehler zu finden und zu beheben. Sicher, Sie haben die Berechtigungen für diese sensible SharePoint-Website, aber warum laden Sie in den letzten 30 Minuten eine große Menge an Dateien von dort herunter?

Es gibt zwei Haupttypen von KI: deterministische und nicht-deterministische. Maschinelles Lernen ist hauptsächlich deterministische KI. Sie eignet sich am besten für die Verarbeitung strukturierter Daten. Deep Learning ist oft eine Art der nicht-deterministischen KI, die sich am besten für die Verarbeitung unstrukturierter Daten eignet.

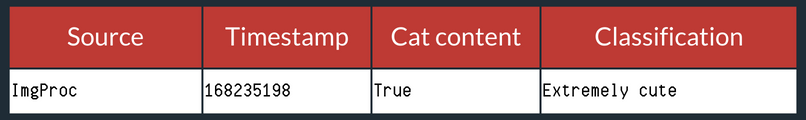

Man kann es auch anders ausdrücken: Deep Learning wäre in der Lage, dieses Bild zu betrachten und zu beantworten: "Wo ist die Katze auf dem Bild?"

Maschinelles Lernen wäre in der Lage, sich eine Protokolldatei anzusehen und die Frage zu beantworten: "Was ist zum Zeitpunkt 168235198 passiert?"

Im Sicherheitsbereich sind die Informationen, die wir betrachten, fast ausschließlich strukturierte Daten, egal ob Sie versuchen, KI zur Bewertung von Authentifizierungs-, Berechtigungs- oder Anwendungsnutzungsdaten einzusetzen.

Das bedeutet, dass wir im Bereich der Cybersicherheit hauptsächlich maschinelles Lernen oder deterministische KI einsetzen wollen. Deterministische KI kann die Eingaben, mit denen wir sie füttern, transparenter verarbeiten als nicht-deterministische KI. "Transparenter" deshalb, weil, seien wir ehrlich, nicht alle von uns (mich eingeschlossen) über die fortgeschrittenen mathematischen Kenntnisse verfügen, um alle Details zu kennen. Viele Menschen jedoch schon, und ein deterministisches ML-Modell kann ihnen in seiner Gesamtheit erklärt werden.

Es gibt Forschung um ein besseres Verständnis der Funktionsweise nicht-deterministischer KI zu erlangen. Ich bin gespannt, wohin dies führt und ob wir am Ende vollständig verstehen werden, wie neuronale Netze und andere nicht-deterministische KI tatsächlich funktionieren.

Genauso wichtig wie der Umgang mit diesen strukturierten Eingaben sind die Ergebnisse, die eine deterministische KI produziert. Nicht-deterministische KI ist eher eine Blackbox: Wir Menschen können nicht genau wissen, wie eine nicht-deterministische KI zum Beispiel ein bestimmtes Bild erzeugt hat. Am Anfang steht die Eingabe, am Ende die Ausgabe, und wenn man die Blackbox in der Mitte öffnet, sieht man ein Fantasieland mit Drachen und Einhörnern: Es ist einfach ein Rätsel.

Bei deterministischer KI können wir wissen, wie unser Modell zu seiner Antwort gekommen ist. Theoretisch könnten wir die Arbeit einer deterministischen KI überprüfen und dieselben Eingaben manuell eingeben, um die gleiche Antwort zu erhalten. Allerdings würde dies eine unvorstellbare Menge an Notizpapier, Kaffee und Verstand erfordern und kann nicht in Echtzeit durchgeführt werden.

Für Sicherheits- und Audit-Teams sind diese Transparenz und das Verständnis für die Funktionsweise der KI entscheidend für die Einhaltung von Vorschriften und die Beantragung von Zertifizierungen.

Das soll nicht heißen, dass nicht-deterministische / Deep-Learning-Algorithmen in der Cybersicherheit keine Rolle spielen. Es gibt sie: Deep Learning kann Antworten finden, nach denen wir nicht gesucht haben, und kann zur Verbesserung deterministischer Modelle verwendet werden. Cybersicherheitsexperten müssten dieser Blackbox - und dem, was sie produziert - ein hohes Maß an Vertrauen entgegenbringen.

Wir setzen stark auf KI und glauben, dass sie eine wichtige Rolle bei der Schaffung einer stärkeren Cybersicherheit spielen kann.

Genauso wichtig wie KI ist jedoch das Zusammenspiel aller Identitätskomponenten: Authentifizierung, Zugriff, Governance und Lebenszyklus müssen zusammenarbeiten, um den gesamten Identitätslebenszyklus zu schützen.

Die Kombination dieser Funktionen zu einer einheitliche Identitätsplattform hilft Unternehmen, die blinden Flecken zu schützen, die sich aus punktuellen Lösungen ergeben; außerdem schafft es mehr Dateninput, um KI zu etwas noch Intelligenterem zu trainieren.