في عام 2017، قالت شركة شاي مثلج مقرها نيويورك إنها "تتحول إلى البلوك تشين"، وقفز سهمها بنسبة 200%.

لقد ذكرت هذا الأمر لأنه بعد مرور ست سنوات, الذكاء الاصطناعي هو كما الطنانة اليوم كما كانت البلوك تشين آنذاك. لقد اختارت أقسام التسويق هذا المصطلح إلى درجة أن ما يعنيه "الذكاء الاصطناعي" - والأهم من ذلك، كيف يمكن أن يخلق حقاً أمناً إلكترونياً أقوى - يمكن أن يضيع في الضوضاء.

كان ذلك واضحًا لي حتى في كوبنجر كول المؤتمر الأوروبي للهوية والسحابة 2023, حيث قدمت عرضًا عن قدرة الذكاء الاصطناعي على منع الاستيلاء على الحسابات. هناك ما هو أكثر من مجرد ضجة حول الذكاء الاصطناعي، لكن قيمته الحقيقية في إنشاء أمن إلكتروني أقوى وتقريب المؤسسات من انعدام الثقة قد تطغى عليها كل هذه الضجة.

لذا، دعونا نحدد مصطلحاتنا وندخل في صلب الموضوع. دعونا نستعرض بعض الطرق التي يمكن للأمن السيبراني من خلالها استخدام الذكاء الاصطناعي لمعالجة بيانات المصادقة والاستحقاق والاستخدام. ودعونا نحدد نوع الذكاء الاصطناعي الذي يمكن أن يعمل بشكل أفضل لتحسين موقف الأمن السيبراني للمؤسسة.

يميل الأمن السيبراني إلى التقسيم إلى كفاءات أساسية: المصادقة متعددة العوامل (MFA) لتأمين الوصول، وحوكمة الهوية وإدارتها (IGA) لفرض أقل امتياز، وإدارة الحوادث الأمنية والأحداث (SIEM) لمراقبة الاستخدام، وما إلى ذلك.

كل من هذه الكفاءات على درجة عالية من التخصص، وتنشر أدواتها الخاصة، وتحمي من مخاطر مختلفة. القاسم المشترك بينهم جميعاً هو أنهم جميعاً ينتجون جبالاً من البيانات.

انظر إلى الهوية، التي تضيف المزيد من المستخدمين والأجهزة والاستحقاقات والبيئات أكثر من أي وقت مضى. في 2021 قال أكثر من 80% من المشاركين في الاستطلاع إن عدد الهويات التي يديرونها قد زاد بأكثر من الضعف، وأفاد 25% بزيادة قدرها 10 أضعاف.

تتحول الهوية بسرعة إلى مشكلة بيانات: هناك معلومات أكثر مما يمكن للبشر التعامل معها. وهذا هو السبب في أن الذكاء الاصطناعي يمكن أن يكون أحد الأصول المهمة: يمكن للذكاء الاصطناعي أن يفهم كميات كبيرة من البيانات بسرعة إذا قمت بتأطير السؤال بشكل صحيح وعرفت ما يجب أن تسأل الذكاء الاصطناعي.

فيما يلي الأسئلة الثلاثة التي يمكن لمحترفي الأمن السيبراني استخدامها لمنع المخاطر واكتشاف التهديدات:

#1. المصادقة: استخدام الذكاء الاصطناعي لفهم من يحاول الدخول

يمكن للذكاء الاصطناعي معالجة بيانات المصادقة لتقييم من يحاول المصادقة على نظامك. وهو يقوم بذلك من خلال النظر إلى سياق كل مستخدم، بما في ذلك الجهاز الذي يستخدمه، والوقت الذي يحاول الوصول إليه، والموقع الذي يدخل منه إلى النظام، وغير ذلك.

الخطوة التالية هي استخدام تلك المعلومات الحالية ومقارنتها بالسلوك السابق لذلك المستخدم المعين: إذا قمت بالمصادقة من نفس الكمبيوتر المحمول وفي نفس الساعات ومن نفس عنوان IP هذا الأسبوع كما فعلت الأسبوع الماضي، فمن المحتمل أن يبدو سياقي جيدًا جدًا.

وبدلاً من ذلك، إذا حاول شخص يدّعي أنه أنا تسجيل الدخول من جهاز جديد في الساعة 3 صباحًا ومن عنوان IP جديد، فيجب على الذكاء الاصطناعي أتمتة المصادقة التدريجية لتحدي هذا السلوك المريب.

والأهم من ذلك، أن تلك القرارات حول ما يشكل "السياق الجيد" و"السياق السيئ" ليست ثابتة: بدلاً من ذلك، يجب على الذكاء الاصطناعي إعادة تقييم قراراته باستمرار لتعكس السلوك العام للمستخدمين والمؤسسات والتكيف مع أي شكل "طبيعي". يتغير سلوك المستخدم دائماً ويحتاج الذكاء الاصطناعي دائماً إلى أخذ ذلك في الاعتبار.

مجموعات القواعد الثابتة ليست دقيقة بما يكفي لمراعاة السياق الفردي وتفتقر إلى عمق البيانات المرجعية اللازمة لأتمتة الإجراءات بثقة.

أو بعبارة أخرى: لن تكون مجموعات القواعد الثابتة قادرة على معرفة ما إذا كان من الطبيعي بالنسبة لي - أنا تحديدًا - أن أحاول تسجيل الدخول إلى 8ال الوقت في غضون 60 دقيقة من ألمانيا في الساعة 23:00. ربما يكون هذا سلوكًا طبيعيًا بالنسبة لي، أو ربما يكون مريبًا. في كلتا الحالتين، لن تتمكن مجموعات القواعد الثابتة من معرفة ذلك.

لما يقرب من 20 سنة, ، تستخدم RSA خوارزميات التعلّم الآلي والتحليلات السلوكية لمساعدة العملاء على تحديد ما يبدو عليه السياق "الجيد" و"السيئ" وأتمتة الاستجابات لسلوكيات المستخدمين. الذكاء الاصطناعي للمخاطر RSA يعالج الكم الهائل من البيانات التي ينشئها المستخدمون لاستكمال تقنيات المصادقة والوصول التقليدية ومساعدة الشركات على اتخاذ قرارات وصول أكثر ذكاءً وسرعة وأماناً على نطاق واسع.

#2 الحساب والاستحقاق: استخدام الذكاء الاصطناعي لمعرفة ما يمكن لشخص ما الوصول إليه

يعالج الذكاء الاصطناعي بيانات المصادقة لمعرفة من يحاول الوصول. يقوم بمراجعة بيانات الحساب والتفويض للإجابة على سؤال مختلف: ما هي يمكن وصول شخص ما؟

تجيب الروبوتات على ذلك من خلال النظر في الحسابات والاستحقاقات لمختلف التطبيقات. ويساعد القيام بذلك المؤسسات على الانتقال إلى الامتيازات الأقل (وهي لبنة مهمة في بناء الثقة المعدومة). يمكن أن يساعد القيام بذلك أيضًا المؤسسات على تحديد أي انتهاكات للفصل بين الواجبات.

بالنسبة للبشر، ستكون معالجة معلومات الحساب والاستحقاق شبه مستحيلة: يمكن أن تصل سجلات الاستحقاق بسرعة إلى الملايين. إن مراجعة تلك البيانات يدويًا لا بد أن تفشل - من المرجح أن يضغط المراجع البشري على "الموافقة على الكل" وينتهي الأمر.

ولكن على الرغم من أن إجراء مراجعة شاملة للاستحقاقات أمر يتطلب جهداً كبيراً، إلا أنه أيضاً ذو قيمة عالية - خاصة في تطوير موقف أقوى للأمن السيبراني. نظرًا لأن البشر يسارعون إلى الضغط على زر "الموافقة على الكل"، فإننا ننشئ حسابات تحتوي على استحقاقات أكثر بكثير مما تحتاج إليه: فقط 2% من الاستحقاقات المستخدمة.

يتسع نطاق مخاطر الاستحقاق هذه مع قيام المؤسسات بدمج المزيد من البيئات السحابية: جارتنر ويتوقع أن "الإدارة غير الملائمة للهويات والوصول والامتيازات ستتسبب في 751 تيرابايت من الإخفاقات الأمنية السحابية" هذا العام، وأن نصف الشركات ستعرض بعض مواردها بشكل خاطئ للجمهور مباشرةً.

يمكن للمؤسسات العثور على رؤى قيمة - مثل المستخدمين الخارجيين - من خلال البحث في بيانات الاستحقاقات الخاصة بهم. يبدو المستخدمون الخارجون متشابهين جداً مع مجموعات أخرى من المستخدمين ولكن لديهم بعض مجموعات الاستحقاقات التي تجعلهم مختلفين. قد لا تكون هذه الاختلافات واضحة مثل انتهاكات الفصل بين الواجبات، ولكنها قد تكون مهمة بما يكفي ليتعرف عليها الذكاء الاصطناعي. ستركز مراجعة الوصول على هؤلاء المستخدمين الخارجيين - وليس على 99% الآخرين من المستخدمين الذين تعتبر استحقاقاتهم أقل خطورة أو الذين تمت الموافقة على نفس الاستحقاقات في السابق.

إن العثور على تلك الإبر الصغيرة في كل أكوام القش الشاهقة أمر سهل بالنسبة للذكاء الاصطناعي ومستحيل على البشر.

#3. استخدام التطبيق: استخدام الذكاء الاصطناعي لمعرفة ما يفعله شخص ما بالفعل

يبحث الذكاء الاصطناعي في بيانات المصادقة لتحديد من يحاول الوصول إنه ينظر إلى بيانات الاستحقاق لفهم ما يقوم به شخص ما يمكن الوصول.

عندما يتعلق الأمر ببيانات استخدام التطبيقات، فإن الذكاء الاصطناعي يحاول الإجابة على ما يقوم به شخص ما بالفعل هل.

هناك دفق مستمر من البيانات المفيدة للغاية في الوقت الحقيقي عبر جميع التطبيقات ومكونات البنية التحتية للمؤسسة: يمكن للذكاء الاصطناعي أن يرى ما هي الموارد التي استخدمتها بالفعل لكتابة هذه التدوينة، ومن الذي ذهبت إليه للحصول على المساعدة، والبيانات التي استشرته، والتطبيقات التي استخدمتها، وما إلى ذلك. وهذا يخبر مؤسستي بما أقوم به والخطوات التي احتجت إليها بالفعل لإكماله.

والأهم من ذلك، يمكن لهذا التحليل أن يكشف أيضًا عن نشاط غير صحيح أو غير قانوني أو غير ممتثل أو محفوف بالمخاطر: لا يعني أن المستخدم لديه استحقاق شرعي أن يجب. AI معالجة بيانات استخدام التطبيق للعثور على تلك الأخطاء ومعالجتها. بالتأكيد، لديك الاستحقاقات الخاصة بموقع SharePoint الحساس، ولكن لماذا تقوم بتنزيل كمية كبيرة من الملفات منه خلال الثلاثين دقيقة الأخيرة؟

هناك نوعان رئيسيان من الذكاء الاصطناعي: الحتمي وغير الحتمي. التعلم الآلي هو في الغالب ذكاء اصطناعي حتمي. وهو الأفضل في معالجة البيانات المنظمة. غالبًا ما يكون التعلم العميق نوعًا من الذكاء الاصطناعي غير الحتمي وهو الأفضل في معالجة البيانات غير المنظمة.

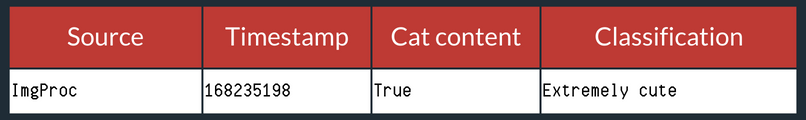

طريقة أخرى لصياغة الأمر: سيكون التعلم العميق قادراً على النظر إلى هذه الصورة والإجابة عن سؤال "أين القطة في الصورة؟

سيتمكن التعلم الآلي من إلقاء نظرة على ملف السجل والإجابة عن "ماذا حدث في الطابع الزمني 168235198؟

في مجال الأمان، سواء كنت تحاول استخدام الذكاء الاصطناعي لتقييم المصادقة أو الاستحقاق أو بيانات استخدام التطبيق، فإن المعلومات التي نبحث عنها هي بيانات منظمة بشكل حصري تقريباً.

وهذا يعني أننا، إلى حد كبير، نريد استخدام التعلم الآلي، أو الذكاء الاصطناعي الحتمي، في الأمن السيبراني. يمكن للذكاء الاصطناعي الحتمي أن يتعامل مع المدخلات التي نغذيها بشفافية أكبر من الذكاء الاصطناعي غير الحتمي. "أكثر شفافية" لأنه، دعونا نواجه الأمر: ليس لدينا جميعًا (بما في ذلك أنا) المعرفة الرياضية المتقدمة لمعرفة جميع التفاصيل. ومع ذلك، فإن الكثير من الناس لديهم ذلك، ويمكن شرح نموذج التعلم الآلي الحتمي لهم بالكامل.

يوجد البحث يحدث للحصول على فهم أكبر لكيفية عمل الذكاء الاصطناعي غير الحتمي. أشعر بالفضول لمعرفة إلى أين سيقودنا ذلك وما إذا كان سينتهي بنا الأمر إلى فهم كامل لكيفية عمل الشبكات العصبية وغيرها من الذكاء الاصطناعي غير الحتمي.

لا تقل أهمية عن التعامل مع تلك المدخلات المنظمة أهمية عن المخرجات التي ينتجها الذكاء الاصطناعي الحتمي. أما الذكاء الاصطناعي غير الحتمي فهو أشبه بصندوق أسود: نحن البشر لا يمكننا أن نكون متأكدين بالضبط كيف أنتج الذكاء الاصطناعي غير الحتمي صورة معينة، على سبيل المثال. هناك المدخلات في البداية، والمخرجات في النهاية، وإذا فتحت هذا الصندوق الأسود في المنتصف سترى أرضًا خيالية من التنانين ووحيد القرن: إنه ببساطة لغز.

مع الذكاء الاصطناعي الحتمي، يمكننا معرفة كيفية وصول النموذج إلى إجابته. من الناحية النظرية، يمكننا نظريًا التحقق من عمل الذكاء الاصطناعي الحتمي وتوصيل نفس المدخلات يدويًا للوصول إلى نفس الإجابة. لكن القيام بذلك يدويًا سيتطلب كمية غير مقدسة من الأوراق والقهوة والعقل ولا يمكن القيام بذلك في الوقت الحقيقي

بالنسبة لفرق الأمن والتدقيق، فإن الحصول على هذه الشفافية وفهم كيفية عمل الذكاء الاصطناعي لديك أمر بالغ الأهمية للحفاظ على الامتثال والتقدم للحصول على الشهادات.

هذا لا يعني أنه لا يوجد دور للخوارزميات غير الحتمية/التعلم العميق في الأمن السيبراني. هناك دور: قد يجد التعلم العميق إجابات لم نبحث عنها ويمكن استخدامها لتحسين النماذج الحتمية. سيحتاج متخصصو الأمن السيبراني إلى وضع قدر كبير من الثقة في هذا الصندوق الأسود - وما ينتجه.

نحن نراهن بشكل كبير على الذكاء الاصطناعي ونعتقد أنه يمكن أن يكون له دور كبير في تعزيز الأمن السيبراني.

ولكن الأمر الذي لا يقل أهمية عن الذكاء الاصطناعي هو أن تعمل جميع مكونات الهوية الخاصة بك معًا: يجب أن تتعاون المصادقة والوصول والحوكمة ودورة الحياة لحماية دورة حياة الهوية بأكملها.

دمج هاتين الدالتين في منصة الهوية الموحدة يساعد المؤسسات على حماية النقاط العمياء التي تنتج عن الحلول النقطية؛ كما أنه يخلق المزيد من مدخلات البيانات لتدريب الذكاء الاصطناعي على شيء أكثر ذكاءً.